Le 24 février 2011, Google déploie une mise à jour qui change la donne du référencement naturel et bouleverse le classement de millions de sites dans le monde. Son nom de code : Panda. Sa cible : les pages qui empilent du contenu de faible qualité pour grimper dans les résultats de recherche. En quelques jours, 11,8 % des requêtes aux États-Unis sont touchées, selon le blog officiel Google Search Central. Des géants comme eHow ou About.com voient leur visibilité s’effondrer.

Quinze ans plus tard, l’algorithme Google Panda a été absorbé dans le core algorithm du moteur de recherche. Mais sa logique reste vivace. Les Helpful Content Updates de 2022 à 2024, les filtres anti-IA et l’évaluation E-E-A-T en sont les héritiers directs. Pour une TPE qui anime un site ou une fiche produit, comprendre Panda reste utile : la moitié des pénalités actuelles sur les contenus trouvent leur source dans les principes de 2011.

Chez Web Guru, agence SEO basée à Romans-sur-Isère, nous auditons chaque année des dizaines de sites de TPE déjà pénalisés par des résidus de logique Panda. Voici ce que vous devez retenir, et surtout ce qu’il faut faire en 2026 pour améliorer durablement votre positionnement.

Google Panda : quel problème l’algorithme a résolu en 2011

Avant Panda, les premières pages de résultats de Google étaient envahies par les fermes de contenu. Le principe a été simple : produire des milliers de pages courtes, optimisées pour des mots-clés à fort volume, sans valeur ajoutée pour l’utilisateur. Demand Media, propriétaire d’eHow, employait des rédacteurs payés 15 dollars par texte pour répondre à toutes les requêtes imaginables. Ces contenus de faible qualité saturaient les résultats de recherche.

Les comparateurs et agrégateurs anglophones inondaient la SERP de pages quasi-vides, gonflées de mots-clés et de publicités. La réécriture automatisée (spinning) faisait fureur : un même texte était dupliqué, légèrement reformulé par un logiciel, puis publié sur des dizaines de sites pour multiplier les positions. Le scraping, qui consiste à copier automatiquement les contenus d’autres sites, devenait une industrie à part entière.

Le résultat a été un internet de plus en plus pauvre pour l’utilisateur final. Google a réagi avec une mise à jour visant directement la qualité des contenus. Amit Singhal et Matt Cutts, qui ont piloté le projet depuis Mountain View, ont diffusé sur l’espace officiel Google 23 questions guides pour évaluer un site, autour de la confiance, de l’expertise et de la valeur ajoutée d’un contenu.

Comment fonctionne l’algorithme Google Panda

Un filtre de qualité site-wide

Panda n’est pas un filtre qui frappe une page isolée. C’est un score de qualité site-wide, appliqué à l’ensemble du site. Si une partie significative de vos pages a une qualité jugée faible, tout le site descend dans les résultats de recherche. Vos pages excellentes baissent aussi. La logique est simple : un site qui héberge des contenus dupliqués, du contenu mince ou des pages auto-générées voit son rang global chuter.

Pour calculer ce score, l’algorithme analyse plusieurs signaux : la longueur réelle des pages uniques, la duplication de contenu interne ou externe, le ratio publicité/contenu, le taux de rebond, le temps passé par les utilisateurs et la diversité du vocabulaire. Google a entraîné Panda avec des évaluations humaines via ses Quality Raters, puis a généralisé ces critères au web mondial.

De la mise à jour ponctuelle au temps réel

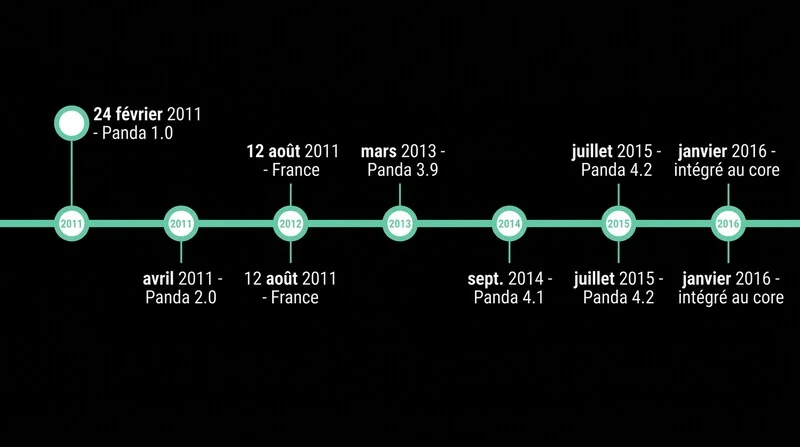

Au lancement le 24 février 2011, Panda était une mise à jour déployée manuellement, par vagues. Chaque version (Panda 2.0 en avril 2011, 3.0 en novembre 2011, jusqu’à la dernière version 4.2 en juillet 2015) demandait plusieurs semaines pour se propager sur l’ensemble des moteurs de recherche. Les webmasters devaient attendre la vague suivante pour voir l’effet d’une correction sur leur trafic.

En janvier 2016, Google a officiellement intégré Panda au core algorithm. Le filtre tourne désormais en temps réel et en continu. Une page corrigée peut retrouver ses positions sans attendre une nouvelle vague. À l’inverse, une page de faible qualité publiée aujourd’hui peut être pénalisée en quelques jours.

Les sites qui ont chuté : eHow, About.com et les autres

Le lancement initial de Panda a fait des victimes spectaculaires. Sistrix et Searchmetrics, deux outils de mesure, ont publié les classements des plus grosses pertes de positionnement dès mars 2011. Les chiffres officiels montrent l’ampleur du choc sur certaines plateformes anglophones. Selon les données Sistrix, certaines fermes de contenu ont perdu jusqu’à 94 % de leur visibilité en moins de trois mois.

Site

Type de site

Perte de visibilité (US)

Cause principale

eHow (Demand Media)

Ferme de contenu

-40 % en 3 mois

Articles courts, peu d’expertise

About.com

Portail de guides

-25 %

Contenu mince, ratio pub trop élevé

HubPages

Plateforme UGC

-50 %

Articles non modérés, duplique

Suite101

Magazine collaboratif

-94 %

Réécriture industrielle massive

Ezine Articles

Annuaire d’articles

-90 %

Duplication systémique

En France, Panda fut déployé officiellement le 12 août 2011. Les comparateurs de prix, les annuaires d’entreprises et certaines plateformes de réécriture ont été les premiers touchés. Les sites institutionnels et éditoriaux qui produisaient des textes longs, signés et sourcés, ont au contraire vu leurs positions remonter mécaniquement. La cause n’est pas un coup de pouce de Google, mais le retrait de la concurrence parasite. Selon Axess et Cybercité, certaines mises à jour Panda ont concerné jusqu’à 9 % des requêtes en France.

Pour replacer Panda dans la chronologie complète, avec Penguin, Hummingbird et RankBrain, consultez notre dossier sur les algorithmes historiques de Google.

Panda, Coati, HCS : la filiation algorithmique

L’algorithme Google Panda n’existe plus en tant que filtre séparé. Depuis 2016, il est noyé dans le core, mais ses signaux sont devenus la base d’une longue lignée de pénalités sur les contenus.

Algorithme

Année

Signal principal

Mode

Panda

2011

Score de qualité site-wide

Vagues puis temps réel (2016)

Coati

2022 (rumeur)

Successeur interne de Panda

Intégré au core

Helpful Content System

Août 2022

Contenu utile vs. SEO-first

Site-wide, mensuel

March 2024 Core Update

Mars 2024

Fusion HCS + core, anti-IA non éditée

Continu

Danny Sullivan, porte-parole de Google, a confirmé en mars 2024 que ce système a été fondu dans le core. Concrètement, les principes de Panda sont devenus invisibles, mais leur effet est continu. Un site qui diffuse des contenus minces, copiés ou générés par IA sans relecture humaine voit son score de qualité baisser. Aucune annonce officielle n’accompagne plus la pénalité.

Pour suivre les annonces officielles, surveillez le Google Core Update, qui regroupe les principales mises à jour récentes du moteur.

Pourquoi Google Panda concerne encore votre TPE en 2026

Vous tenez un site de plomberie à Romans, un cabinet de courtage à Valence, une boutique en ligne de vêtements à Lyon. Vous n’avez jamais fait de spinning et pensez que Panda ne vous concerne pas. C’est faux : trois cas reviennent régulièrement dans nos audits chez Web Guru.

Cas n°1 : les fiches produit dupliquées. Vous vendez 200 références sur votre boutique. Les descriptions viennent du catalogue fournisseur, identiques à celles de vos concurrents. Google détecte la duplication et fait chuter votre rang dans les profondeurs de la SERP.

Cas n°2 : le blog gonflé à l’IA. Vous avez fait générer 80 contenus avec ChatGPT pour couvrir tous les mots-clés du secteur. Aucune relecture, aucune expertise ajoutée. Le filtre repère la pauvreté lexicale, le manque d’auteur identifié et la similarité avec d’autres pages générées. Tout votre site perd en visibilité, y compris vos pages services.

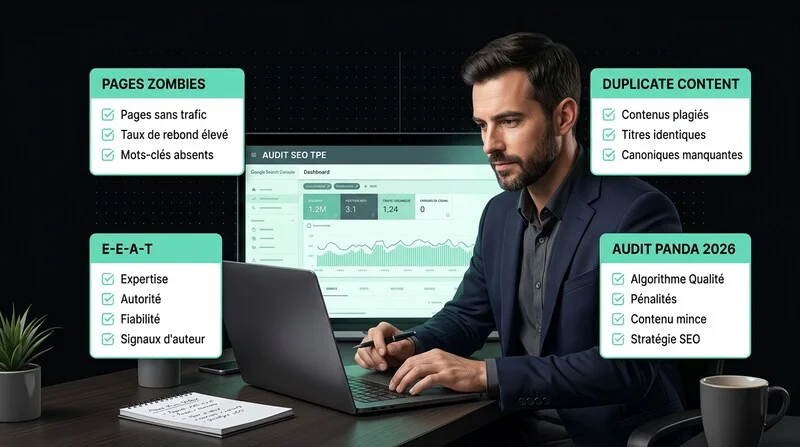

Cas n°3 : les pages zombies. Vous avez 150 pages mises en ligne, dont 90 reçoivent zéro visite par mois. Ces pages tirent vers le bas votre score de qualité global. La solution n’est pas d’écrire encore plus, mais un audit qui désindexe ou fusionne les pages faibles avant la prochaine pénalité.

Pour ces trois cas, la réponse est éditoriale avant d’être technique. Notre offre gestion de contenu consiste à auditer l’existant, supprimer le ballast et reconstruire les contenus qui méritent leur place.

Audit anti-Panda 2026 : la méthode actionnable pour une TPE

Un audit anti-Panda efficace tient en six étapes que vous pouvez lancer dès cette semaine, même sans expertise SEO poussée. Nous l’utilisons sur chaque mission de référencement chez Web Guru, avec des résultats mesurables en 90 jours.

- Cartographier les pages zombies. Ouvrez Google Search Console. Filtrez les pages avec moins de 5 impressions sur 12 mois. Ces URLs sont vos premières candidates au tri.

- Détecter le duplicate content. Utilisez Screaming Frog (gratuit jusqu’à 500 URLs) ou Sitebulb. Repérez les balises title, meta et H1 identiques entre plusieurs pages.

- Scorer chaque page sur l’E-E-A-T. Posez-vous quatre questions : qui a écrit l’article ? Quelle expérience prouve-t-il ? Quelles sources sont citées ? Y a-t-il une mise à jour datée ?

- Décider : garder, fusionner, dépublier. Une page à zéro trafic et zéro valeur ajoutée se dépublie. Deux pages similaires se fusionnent en une, plus longue et plus pertinente. Une page faible mais sur un sujet stratégique se réécrit en profondeur.

- Améliorer les pages gardées. Ajoutez des sources, un auteur identifié, des données chiffrées, des visuels originaux, une FAQ. Visez 1 200 mots minimum pour un article informatif, 600 pour une page service.

- Mesurer l’effet à 90 jours. Comparez le trafic organique avant/après dans Search Console. Une remontée se voit généralement entre 6 et 12 semaines.

Cette méthode est alignée avec les recommandations publiques de Google. La documentation officielle Google sur le contenu utile détaille les critères que Panda et ses successeurs continuent d’évaluer. Un audit régulier protège des pénalités automatiques qui tombent en continu.

Les signaux Panda qui pénalisent encore en 2026

- Ratio publicité/contenu supérieur à 30 % above the fold

- Pages de moins de 300 mots sans donnée chiffrée ni illustration

- Articles signés par un auteur anonyme ou générique (“L’équipe”)

- Plus de 20 % de duplication interne (catégories, tags, filtres mal configurés)

- Mises à jour absentes depuis plus de 24 mois sur des sujets datés

- Contenu généré par IA non édité, détectable par la baisse de variance lexicale

Pour aller plus loin sur la formation de vos équipes internes, notre article formation SEO Google gratuite donne les bases pour identifier seul ces signaux. Pour un audit Panda complet réalisé par nos consultants, parlons-en via notre offre référencement naturel SEO.

Étude de cas : un site e-commerce de Drôme qui récupère +47 % de trafic

Début 2024, un client de Web Guru, négociant en vins basé près de Tain-l’Hermitage, nous contacte. Son site a perdu 62 % de sa visibilité organique en huit mois. Aucune sanction manuelle dans Search Console. L’audit initial prend trois heures : 340 fiches produit utilisent la description fournisseur à l’identique, et 80 pages de 2018 cumulent zéro impression.

Le plan d’action a tenu en quatre points clés. Désindexation immédiate des 80 pages zombies via balise noindex. Réécriture des 60 fiches phares avec dégustation propre, accord mets-vins et photos maison. Fusion des 280 fiches restantes en pages famille de cépage plus riches. Ajout d’un schéma auteur sur chaque page restante, avec photo et bio du négociant.

Résultats mesurés à 6 mois dans Google Analytics 4 : +47 % de visibilité organique, +63 % de revenu e-commerce attribué à la recherche naturelle, et 12 nouvelles requêtes en première page. Le coût total du chantier a été de 4 800 euros, amorti en 11 semaines. La logique reste la même : moins de pages, mais des pages qui méritent leur place dans la SERP.

Vous reconnaissez votre situation dans ce cas ? Nos consultants à Romans-sur-Isère se déplacent partout en Auvergne-Rhône-Alpes pour réaliser l’audit de votre site et proposer un plan chiffré. Côté outils, l’analyse SEO Google que nous utilisons vous est restituée en clair, sans jargon, avec des actions priorisees par impact business.

Articles connexes

Pour replacer Panda dans son contexte, voir algorithmes historiques google et la vue d’ensemble actualite google.

Boostez votre visibilité sur Google

Découvrez les opportunités cachées de votre site avec notre audit SEO personnalisé.

- Analyse technique complète

- Recommandations personnalisées

- Sans engagement

Réponse sous 24h